“追赶”OpenAI的中国公司们,步子迈得越来越大了。

6月6日,快手发布了AI视频生成模型“可灵”,视频生成时长直接赶超Sora达到了120秒,且已在快影App中对创作者开放邀测。过去几天中,一些自称获得测试资格的博主po出了他们使用“可灵”直出的AI视频,一直不太高调的快手AI在海内外社交媒体迅速出圈。

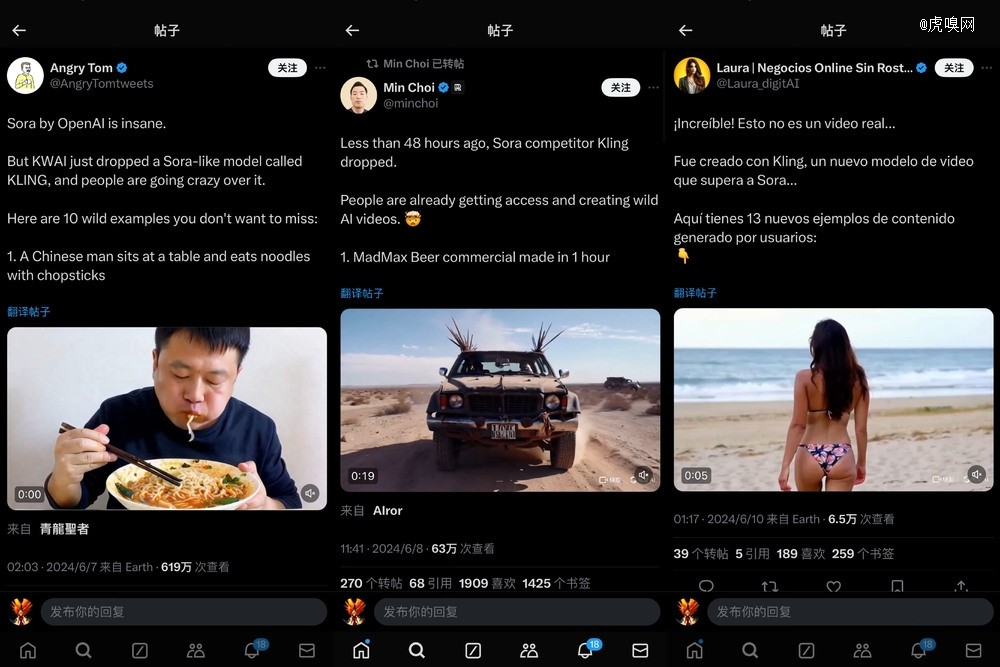

X博主发布的带有“可灵”水印的视频

在Sora刚刚推出的时候,其生成的视频时长和效果被一些创作者认为非常适合短视频创作,很可能会给今天的短视频行业带来颠覆,还引发了“Sora杀死剪映”的热议。

如今,Sora尚未对剪映出手,但抖音的老对手快手却正在借助“可灵”在AI视频生成赛道给快影上提速。对于5月中旬刚刚推销过一波AI大模型产品的抖音集团而言,与快手的战火正在烧向AI。

内容之争是根本

在Sora对标大战中,快手发力AI的战术目标,更像是要绕到对手身后围绕“内容创作者资源”展开一场“偷袭”。

说到短视频平台对AI视频生成技术上的关注,就不得不分析一下AI生成的视频内容,对于用户的价值,以及这些内容对用户的影响心智。

“Sora类模型生成的内容*的问题是‘听起来很酷’。”AI类视频创作者阿达(化名)告诉虎嗅,粉丝需要的是有新鲜感或者有情绪价值、内容价值的视频,Sora类视频的特点是“逼真”,但只是模仿真实世界的AI视频,不管是开汽车还是东京漫步,对于用户来说基本上提供不了任何价值,而新鲜感也会很快淡化。

“你*次刷到AI视频,一个老虎迈着有点畸形的步伐往前走,你可能觉得有趣。但你刷到第二条类似内容时大概率就不会停留了。”阿达认为,有那么多有趣的“真”视频,用户为什么要花时间去看AI生成的“假”视频。

“可灵”生成的AI视频

很多短视频平台对AI视频的态度亦是如此——从用户视角去判断价值。

多位AI视频和数字人内容创作者对虎嗅表示,有些视频平台似乎不鼓励AI合成内容,这类视频分到的流量不多,有的甚至会被限流。

除此之外,AI内容的真实、安全性亦是平台要考虑的问题。AI换脸、造假,以及各种深度伪造的诈骗案件屡见不鲜,如果大量逼真的AI合成视频涌入平台,很可能会给视频平台带来更大的甄别压力。目前,各大内容平台都有相关限制,AI生成内容均会标注“作品疑似AI合成,请谨慎甄别”。

不过,对于快手来说,AI视频模型的价值可能并不在用户侧。

多年以来,快手一直试图调整自己与抖音在用户画像上的差异,并适度淡化“下沉”标签,而这就意味着快手需要丰富“内容供给”,扩大内容种类、风格,而关键资源正是创作者。目前来看,在快影当中提供AI生成视频功能,很可能是吸引优秀创作者的一个好方法。

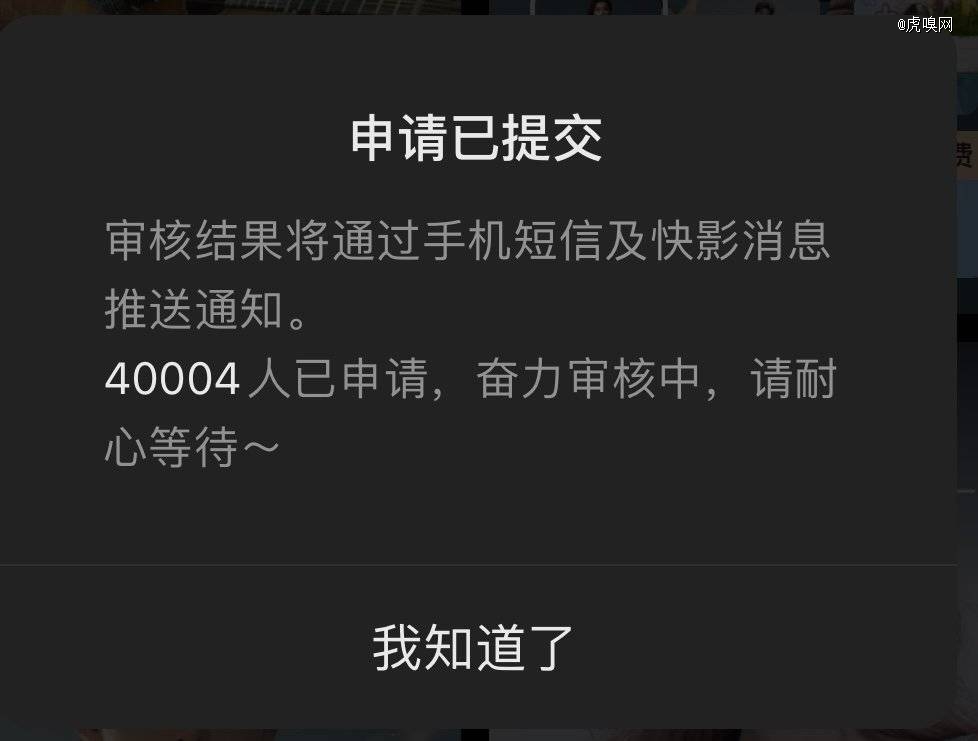

截至发稿,快影App中显示的“可灵”内测申请人数已超40000。据虎嗅了解,其中相当多的申请者是创作者和创作团队。从目前来看,“可灵”无疑是给快影做了一波大营销。

此外,AI视频生成功能还能拉拢更多“新生”的创作者力量。

某MCN机构负责人告诉虎嗅,从过去一年短视频平台的热点内容看,未来一段时间里平台对高质量内容的判断大概会聚焦在以下方面:能够引起广泛用户参与、与文化自信和教育相关、具有社会责任感、提供实用信息、娱乐性强、能够激发UGC创作,以及能够建立个人品牌和影响力。

AI视频生成功能简化了视频制作流程,在“引起广泛用户参与、激发UGC创作”这两方面能起到积极作用。对于创作者来说,一方面能够帮助传统图文创作者基于已有内容做视频创作,加速内容迁移。另一方面也可以降低普通用户参与视频创作的门槛。

在短视频之争中,其他短视频平台玩家似乎也关注到了AI视频的创作者逻辑,正在持续加码AI视频模型。

5月中旬召开的腾讯云产业峰会上,腾讯首次公布了混元的16秒视频生成能力,并提出2-3个月内开放文生视频API接口的计划,以及2024年第三季度视频生成时长突破30秒的目标(在腾讯云的一次媒体沟通会中,混元大模型相关负责人曾表示年内可以达到60秒)。

相比抖音和快手,视频号的优势是庞大的用户规模,眼下的短板之一则是内容供给丰富度,然而视频号在内容广度和深度方面仍与抖音和快手存在明显差距。短视频和直播平台的内容质量对培养用户习惯和增加使用时长至关重要,同时庞大的内容库也是平台变现的基础。

如此看来,视频号遇到的挑战和机会似乎与快手暗合,都是要加速吸引站外创作者来丰富内容生态,并促进现有优质图文创作者向视频迁移。

AI竞赛中的成本思考

过去一年多时间里,抖快在AI领域的“军备大赛”有日渐升温趋势。

抖音集团关于AI的动作和传闻一直没断过,从10亿美元购买GPU,到利用API“扒“ChatGPT数据,再到豆包在国内AI应用榜夺冠,抖音集团一直是AI行业里低调的明星。反观快手,在生成式AI方面的动作却似乎不多,*自研大模型“快意”直到2023年底,才加入到第三批网信办大模型备案。

在AI视频方面,抖音集团虽然没有Sora类的强大AI视频生成模型,但也发布了PixelDance、MagicVideo、AnimateDiff-Lightning等视频模型,目前抖音集团也有专门的AIGC产品即梦(Dreamina),可以完成一些短视频生成功能。

除了AI模型和产品方面的研究,抖音集团在基础设施方面投入巨大。在前面提到的10亿美金采购GPU传闻外,抖音集团旗下的火山引擎,在当下的国产大模型价格战中,亦是“打响*枪”的厂商。快手的云基础设施关注范围则相对较小,以音视频和AI领域为主。

在AI视频方面,快手的进程也不高调,但并非风平浪静。2024年5月初,快手专家研究员王鑫涛曾在一次学术会议中做过一次题为《视频生成的初探及可控性研究》的分享,其中就提到了快手的视频生成方案Tune-A-Video。

技术tips:

Tune-A-Video的关键是“时空自注意力机制”。这种技术可以结合空间(图像)和时间(视频帧序列)上的信息,以提高视频生成和处理的效果。假设视频内容是一只小狗在草地上跑。时空自注意力机制的工作过程是:

空间自注意力会分析每一帧中小狗身体的各个部分,例如头、腿、尾巴之间的关系。

时间自注意力会关注每一帧中小狗的位置和姿势变化,确保小狗在跑步的过程中动作是连贯的,不会出现瞬间移动或姿势不连贯的现象。

综合考虑这些信息后,模型能够生成一个流畅、自然的跑步小狗的视频,即使用户修改了小狗的颜色或背景场景,生成的视频仍能保持运动的一致性和视觉上的连贯性。

技术之争的背后,一定潜藏着对未来商业化的谋篇布局。然而AI技术如何商业化,目前仍是短视频以及很多行业讨论的核心问题之一。

AI视频模型要商业化至少需要解决两个问题,*是技术层面的视频生成质量和效率,第二是成本。

从Runway、Pika等AI公司的3、4秒视频模型,到OpenAI推出Sora,很多业内人士也没想到技术发展会如此之快。Sora之后,各家AI公司的追赶速度更是令人咋舌。

“AI生成视频的质量可能不会长期困扰行业,但成本问题很难解决。”一位关注AI视频的投资人告诉虎嗅,视频模型的算力需求比语言模型大很多,优化的难度也更高。“从ChatGPT和Sora的开放程度就能看出来,ChatGPT可以开放给亿级用户,而Sora至今只有少数人试过。”

主流猜测认为Sora模型参数量约为30亿,其训练数据可能包括过去五年的YouTube所有视频。投资机构Factorial Funds发表的一篇博文分析认为,Sora模型的一次训练大概需要4200~10500块英伟达H100 GPU 训练1个月。

30亿参数相比于GPT-4的1.8万亿参数,训练成本会低很多。然而视频模型与语言模型相比,更大的开支在推理端。

举个例子,要生成一个2分钟的视频,在不考虑视频的连贯性和时空一致性的情况下,把AI视频拆成一帧一帧的图片。

按照某国内AI公司最近公布的AI图片生成*折扣价算,生成1张图片的价格*0.06元,1秒25帧,花费1.5元,120秒的视频成本为180元。

以快手开启的“可灵“邀测为例,假设“可灵”上线后3天内的内测申请者全部通过,每人每天试验20分钟视频,则每天的测试开销约7200万元。快手2024Q1期内利润41亿元,如果要满足全部“可灵”测试需求的话,2个月可能就要面临亏损了。

“可灵”内测申请提交通知

这还只是按生成单张图片计算的价格,如果要保证这25帧图片连续一致,价格会成倍上涨。一位AI视频模型开发者告诉虎嗅,AI视频生成的难点在于保持多个图片的一致性,相比于普通的AI图片生成,算力消耗和成本会大幅提升。

现阶段要大规模实现AI视频生成的商业化落地,推理成本更是天文数字。

Factorial Funds在Sora分析博文中提到,目前TikTok每天上传的视频总时长约1700万分钟,YouTube为4300万分钟。

假设AI视频模型真的成为生产力,可能会渗透到50%的TikTok短视频和15%的YouTube视频中,这样的渗透率之下,峰值算力需求可能达到72万块H100 GPU。按目前国内的GPU价格,每天的成本将超过千亿。

不过,这种试算在今天看来其实意义不大。AI视频模型要真的大规模渗透,模型成本和效率可能需要比今天低几个数量级。到时候全球市场上主流GPU的算力如何,使用成本如何也是未知数。

抖快之外,创业公司也在入局

6月6日奇绩创坛2024春季创业营路演上半场的最后一个项目*科技,展示了一款AI视频生成大模型“视界一粟YiSu”。

您目前设备暂不支持播放*科技的视频展示

这款模型生成视频的原生时长为16秒,最长可达1分钟,据*科技介绍,该模型对算力需求不高,已经可以实现“端侧”运行,相关应用接近Sora效果。

项目介绍结束,现场数百位投资人罕见地爆发了喝彩和掌声,资本对AI视频生成技术的关注仍在持续发酵。

在天使轮的*科技路演同天,AI视频生成技术的主力生数科技和Pika,先后宣布了最新融资,两家公司融资额不相上下,生数科技宣布获得数亿元人民币,Pika则筹集到8000万美元。

AI视频模型公司的研究大多集中在提高视频质量和降低推理成本。多数研发AI视频生成模型的团队均表示已经在工程方面有所突破,算力需求正在下降。生数科技CEO唐家渝则表示,“生数科技的团队已经积累了完整高效的工程化经验,拥有在大规模GPU集群上实现高效兼容、低成本的模型训练经验。”目前生数科技和清华大学联合开发的模型Vidu视频生成时长已达到32秒。

在抖快这样的短视频巨头的竞争中,独立AI公司的优势在于早期的技术积累和更“轻快”的开发模式。

然而这些公司目前的融资规模和当前的市场体量匹配度并不高,如果AI视频模型真要落在短视频这样的ToC赛道的话,独立AI公司在没有巨大技术突破的情况下,很可能会倾向于“择木而栖”。

巨头们对于这些AI公司的态度也在逐渐暧昧。

细看生数科技的这轮融资,其中新增了百度。虽然生数科技的早期投资人中有百度风投的身影,但百度风投与百度之间其实只是VC和LP的关系,而百度在过去一年多里对模型公司“亲自”出手,只有生数科技这一次。

虽然百度在刚刚推出文心大模型后不久,就提出过一些Text2Video的相关模型和技术,并演示了AI文生视频功能,但后续一直没有正式发布相关模型或产品。

目前,包括硅谷巨头在内的多数平台型大公司在AI视频模型方面均没有公布过大额投入。

293906/11

293906/11

京公网安备 11011402013531号

京公网安备 11011402013531号